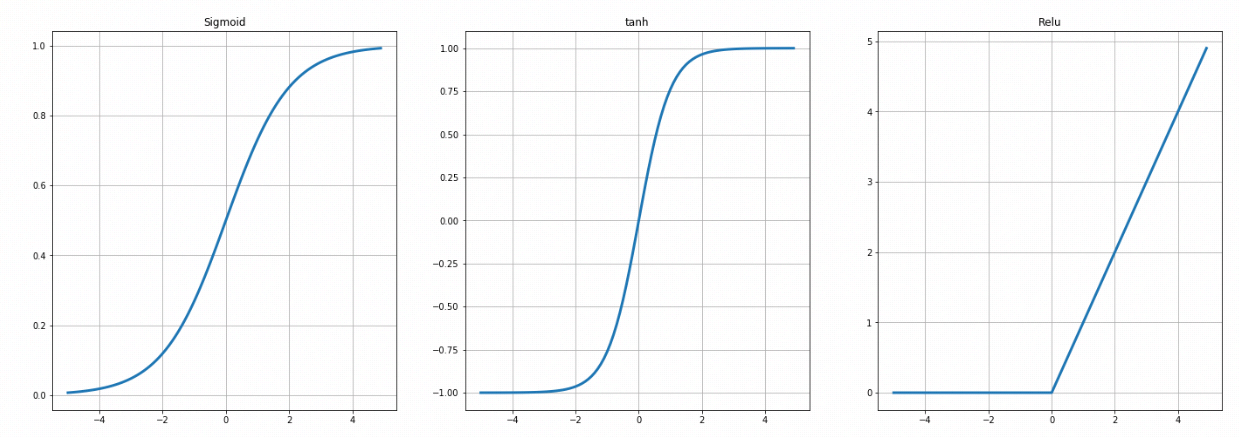

python绘制sigmoid及tanh函数

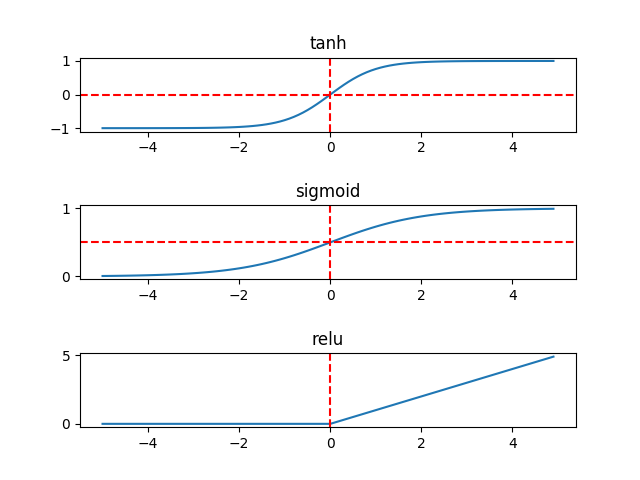

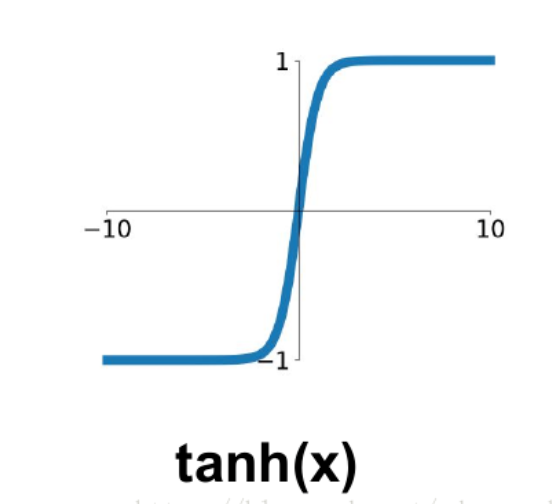

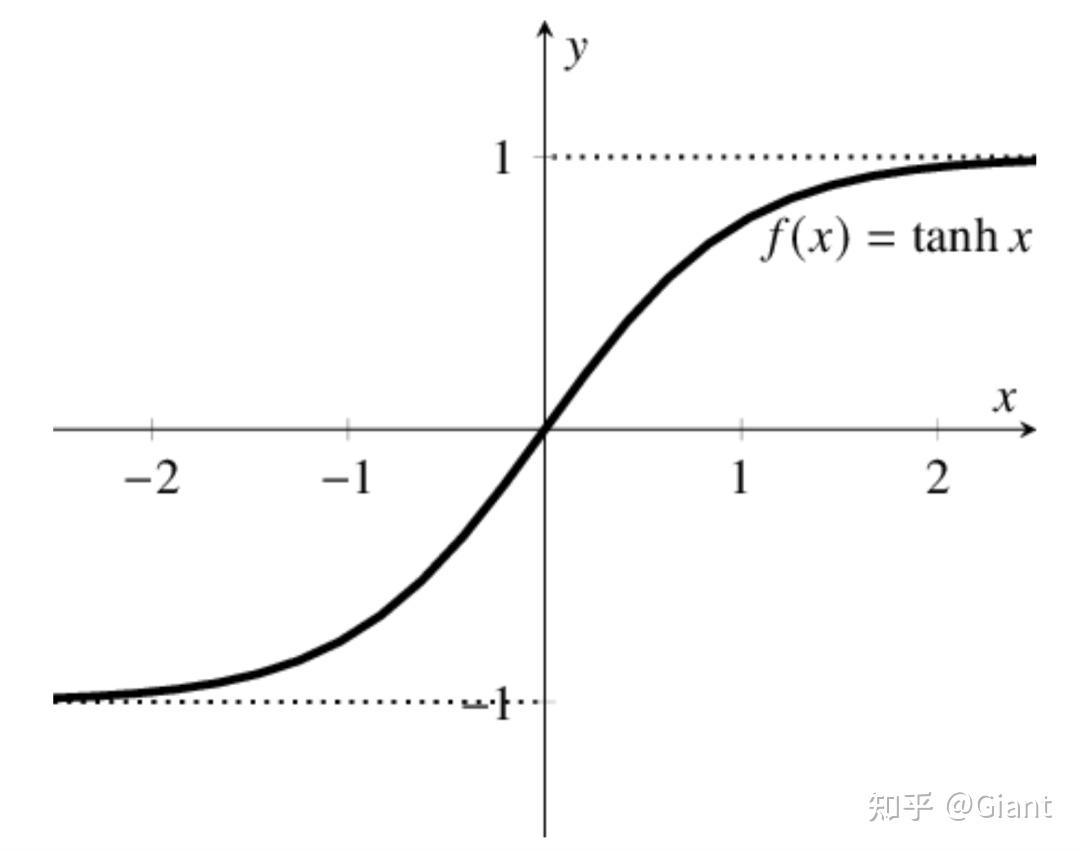

神经网络算法常用激活函数sigmoidtanhrelu

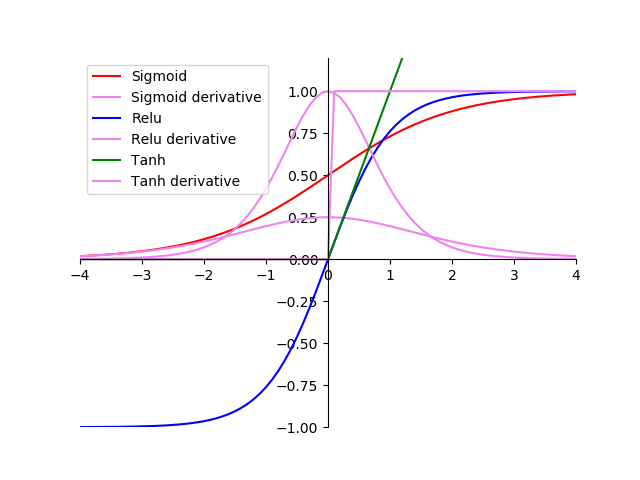

python绘制激活函数曲线图及其导数曲线图激活函数包括sigmoidrelu

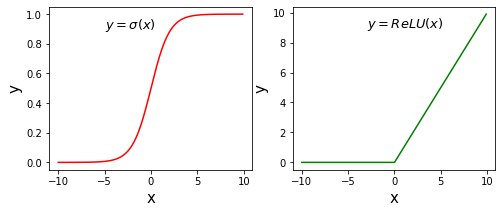

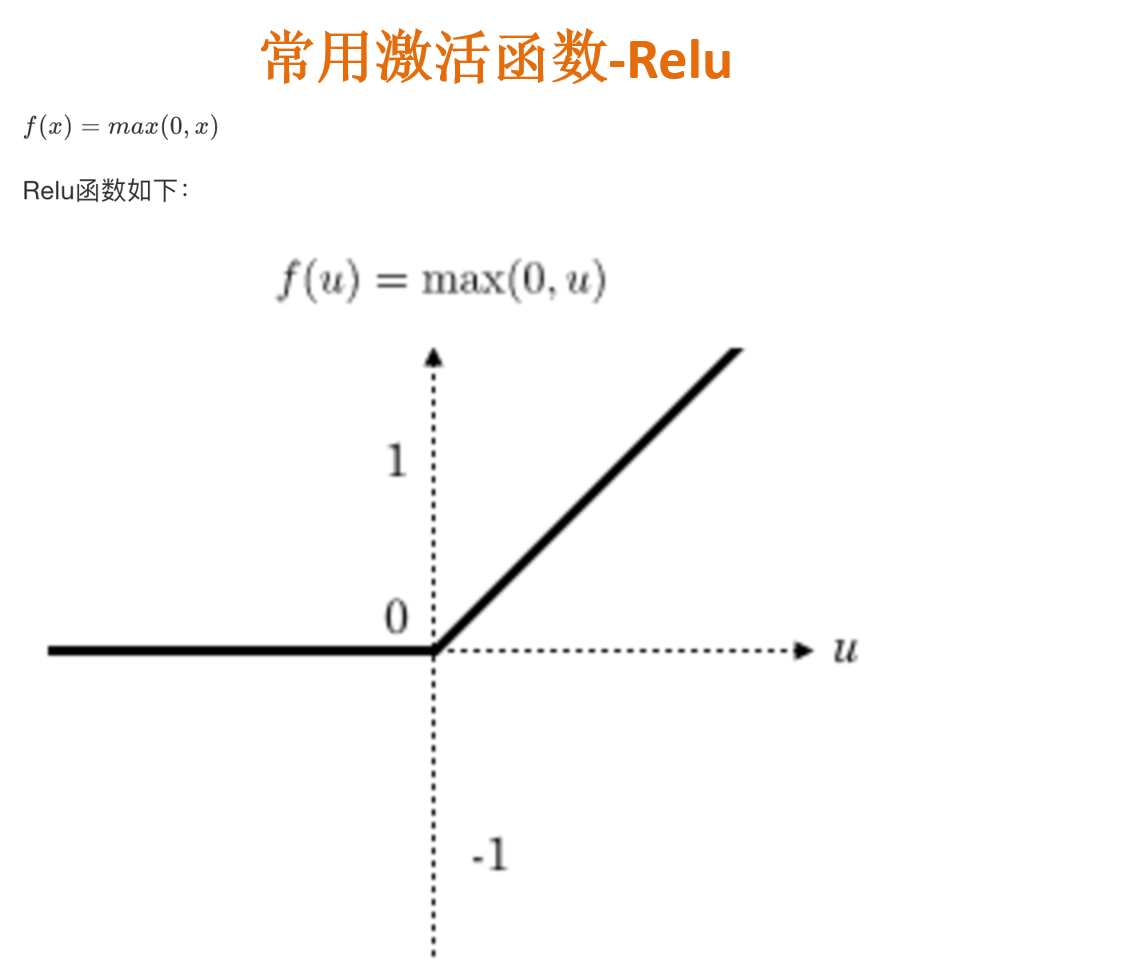

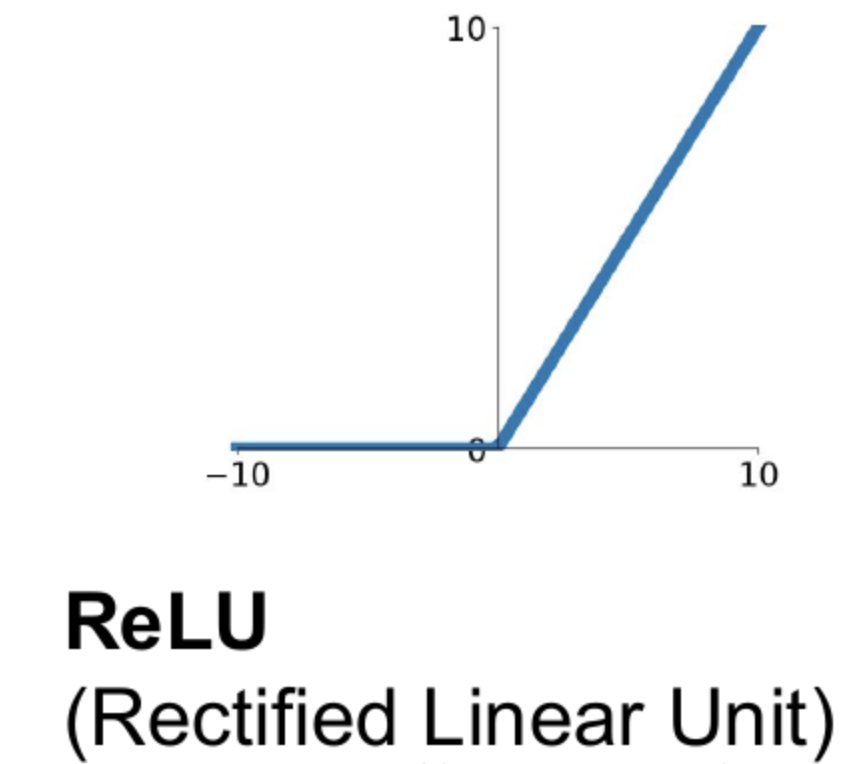

relu和sigmoid函数图像

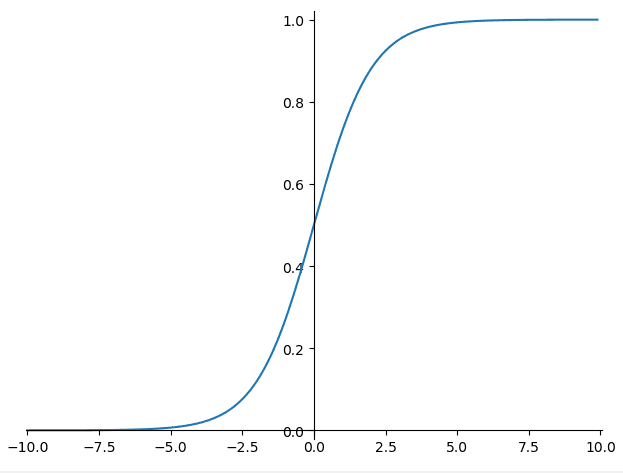

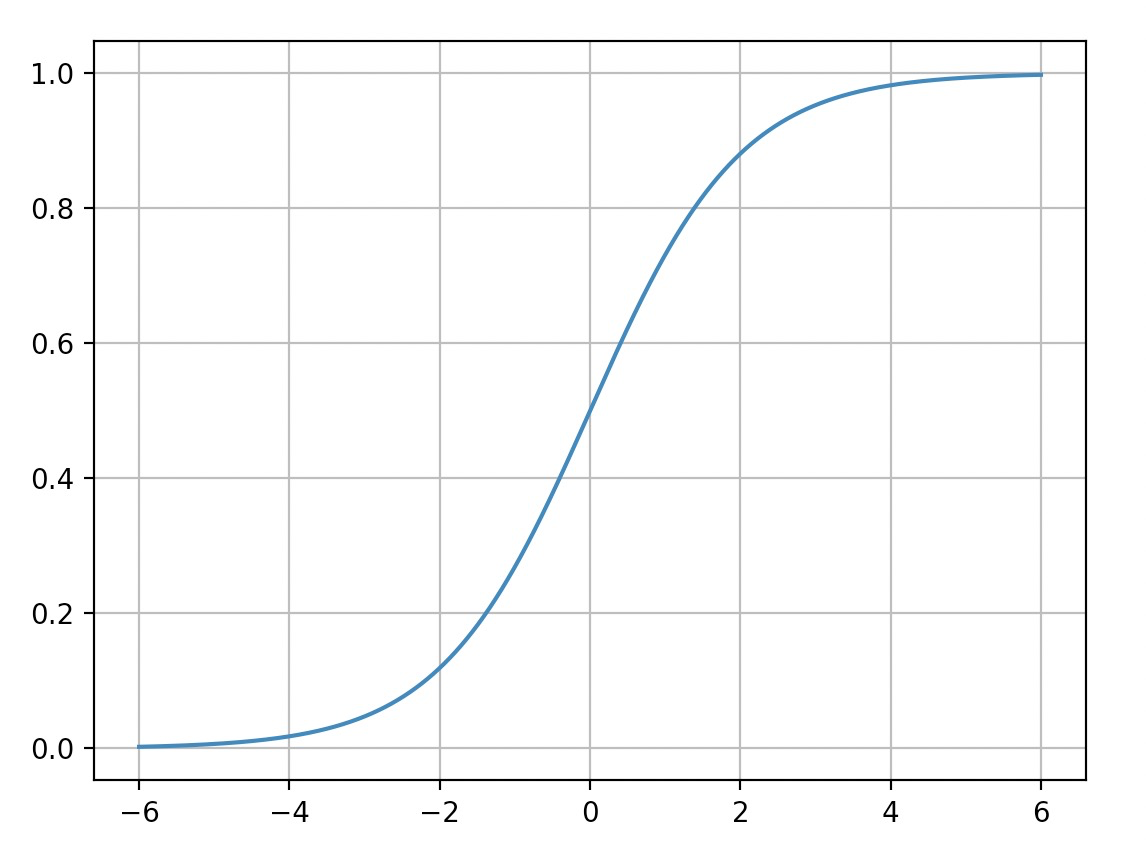

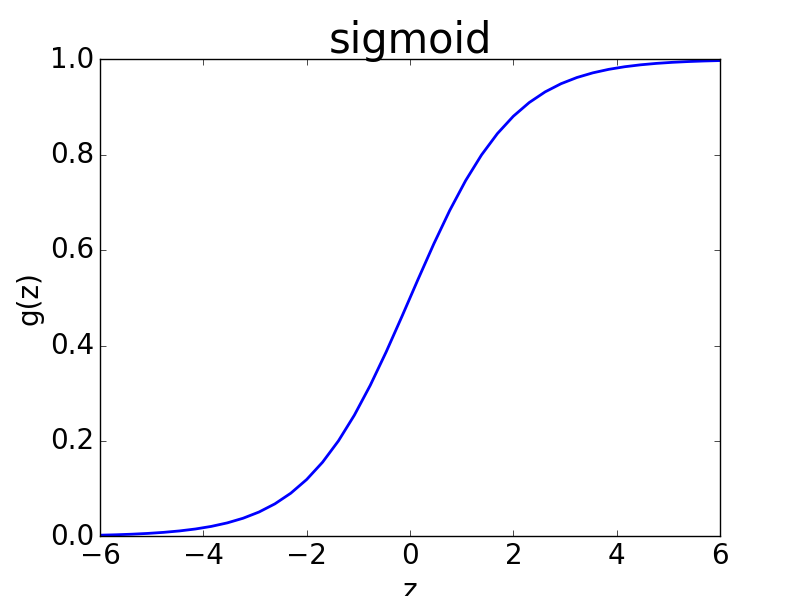

sigmoid

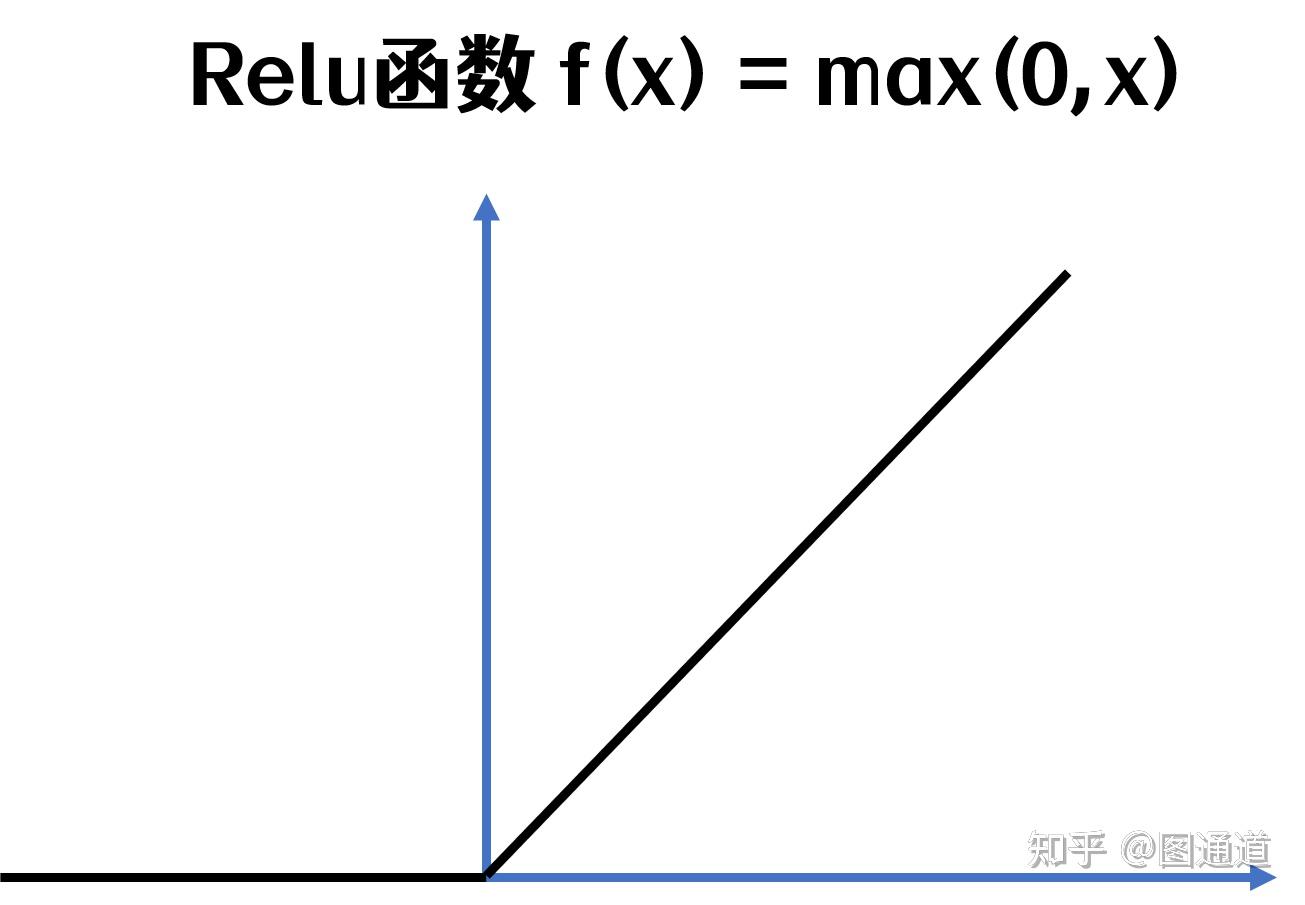

优点:收敛速度快相较于sigmoid和tanh函数,relu对于随机梯度下降的

深度学习中的激活函数之sigmoidtanh和relu

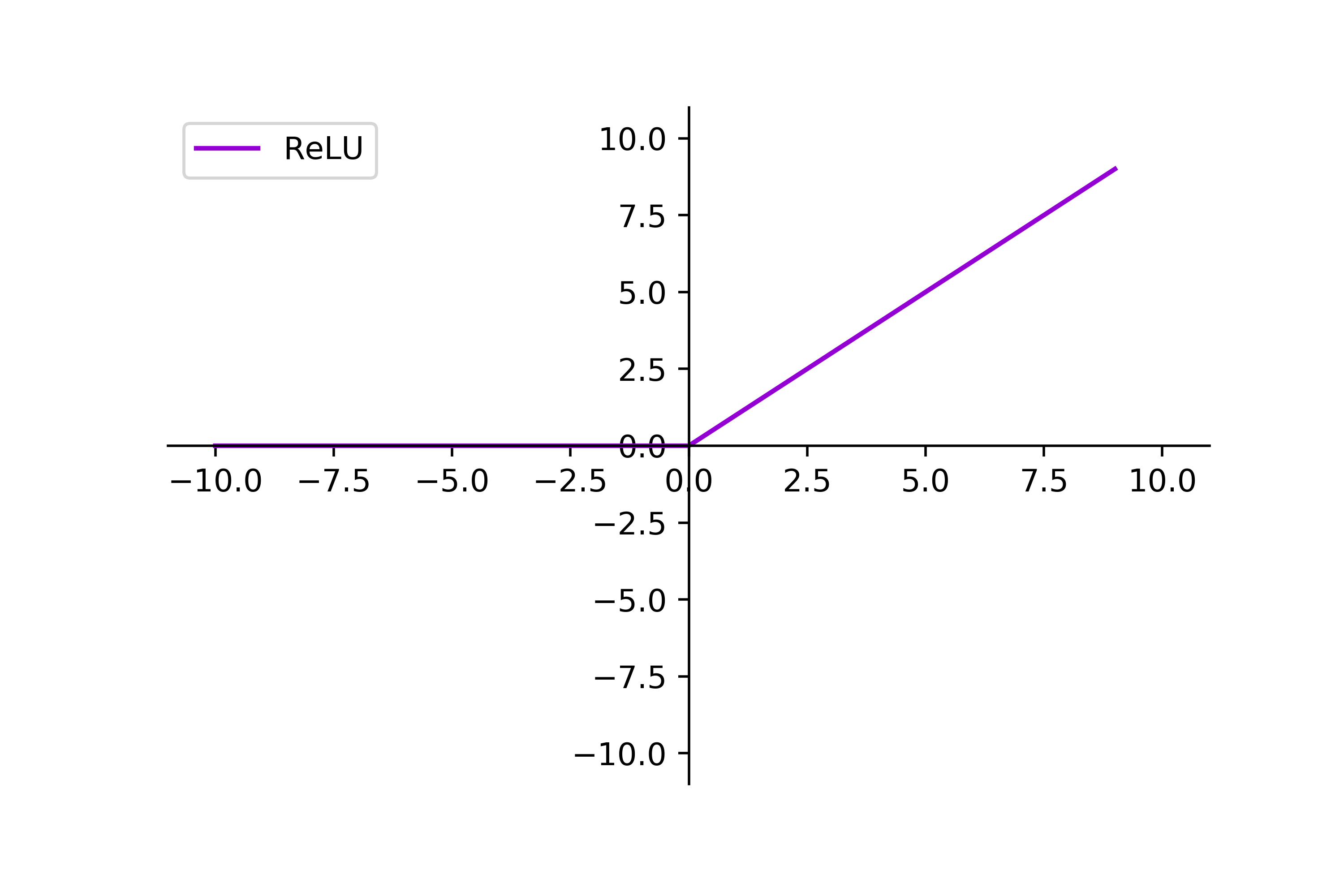

3 激活层(relu)

python画出激活函数 sigmoid,tanh,relu,prelu

深度学习的激活函数sigmoidtanhreluleakyrelurrelusoftsignsoftplus

sigmoid

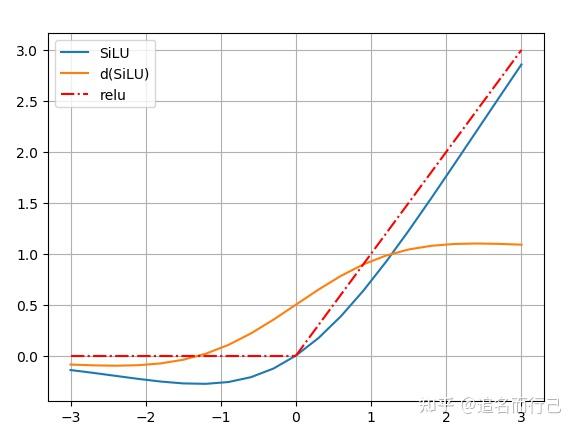

3 silu: sigmoid

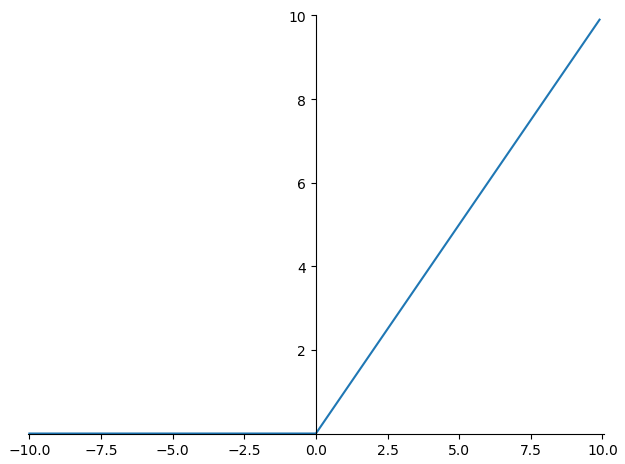

relu函数图像

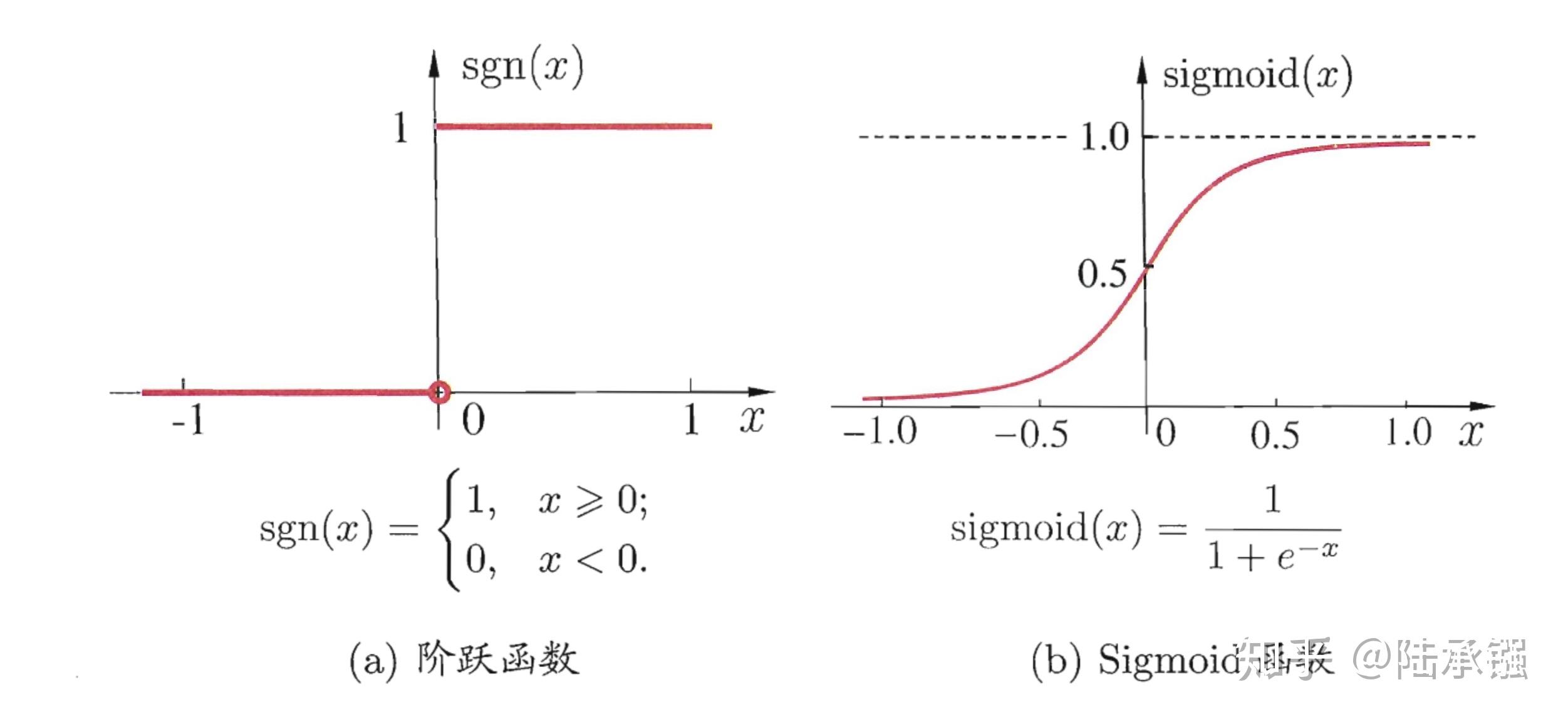

sigmoid的表达式及图形relu的表达式及图形

【深度学习】——神经网络中常用的激活函数:sigmoid,relu,tanh函数

为什么要用relu激活函数,而不用sigmoid激活函数?

siluxx65sigmoidx激活函数

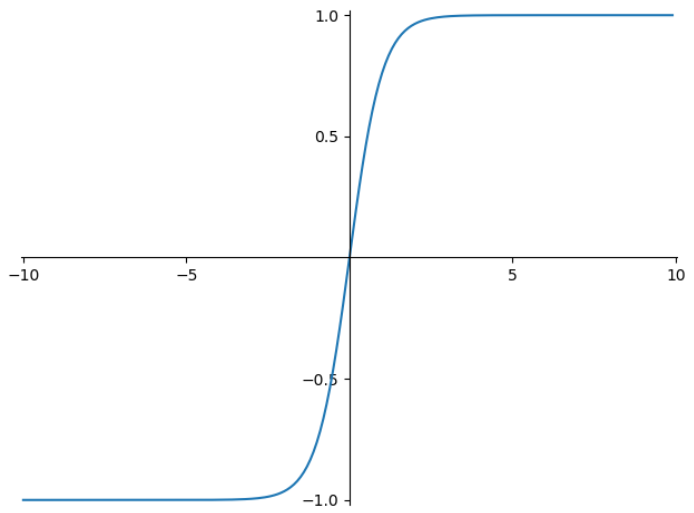

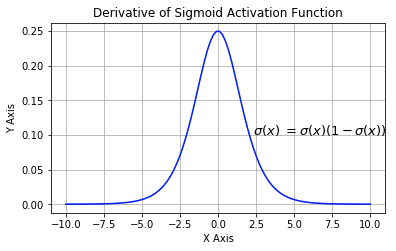

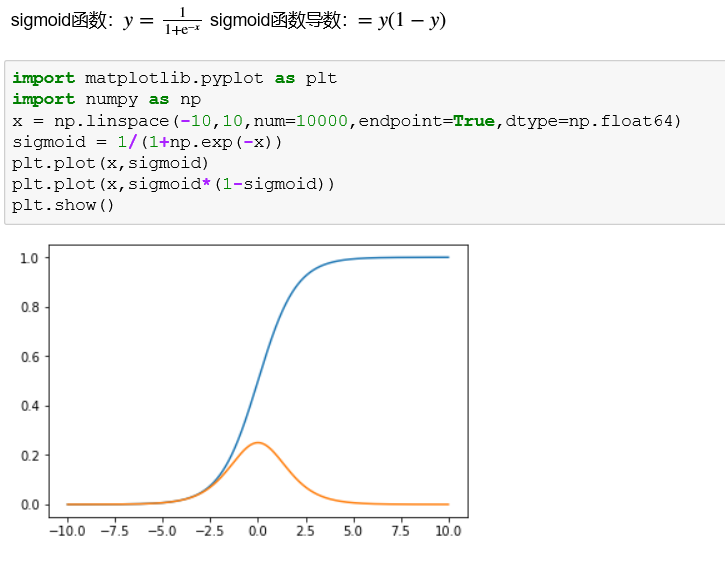

下图展示了 sigmoid 函数及其导数:$$\sigma(x)=\frac{1}{1 e^{

机器学习

常见的激活函数 sigmod relu tanh leakyrelu及复现代码

激活函数sigmoidtanhreluswish

sigmoid函数总结

relu计算上比sigmoid或者tanh更省计算量,因为不用exp,因而收敛较快

深度学习中的激活函数之sigmoidtanh和relu

sigmoid激活函数

sigmoid 函数

人工智能深度学习10神经网络基础激活函数之sigmoid与二元逻辑分类的

激活函数总结sigmoidtanhrelulrelpreluelugelu和selus

从sigmoid到gelu一文概览神经网络激活函数

深度学习的激活函数sigmoidtanhreluleakyrelurrelusoftsignsoftplus